Wie du mit ChatGPT & Github Copilot täglich 2 Stunden sparst

Wer kennt es nicht: Stunden vergehen mit langweiligem Boilerplate-Code, Doku schreiben oder immer gleichen Routine-Aufgaben. Doch genau hier können ChatGPT und GitHub Copilot helfen. Diese KI-Tools übernehmen repetitive Programmierarbeit, während du dich auf die wirklich kreativen Aufgaben konzentrierst. Viele Entwickler nutzen solche Tools bereits täglich. Laut einer aktuellen Umfrage arbeiten 85 % regelmäßig mit KI-Unterstützung und 9 von 10 sparen dadurch mindestens eine Stunde pro Woche ein. Jeder Fünfte gab sogar an, über 8 Stunden pro Woche (also mehr als einen vollen Arbeitstag) durch KI-Helfer gutzumachen. Richtig eingesetzt kannst auch du auf rund 2 Stunden Zeitersparnis pro Tag kommen.

Ziel dieses Artikels: Wir zeigen konkrete KI-Workflows, mit denen du deinen Entwickler-Alltag effizienter gestaltest. Von den Arten von Aufgaben (Code generieren, erklären, prüfen) über effektive Prompt-Muster bis hin zur Code-Erstellung mit Tests und Doku, dem Code-Review mit Sicherheitsnetzen und den Grenzen der Tools. Nach diesem Blogartikel weißt du genau, wie du ChatGPT und Copilot optimal einsetzt. Auch wenn du noch wenig Erfahrung mit KI hast: Keine Sorge, wir holen dich Schritt für Schritt ab. Los geht’s!

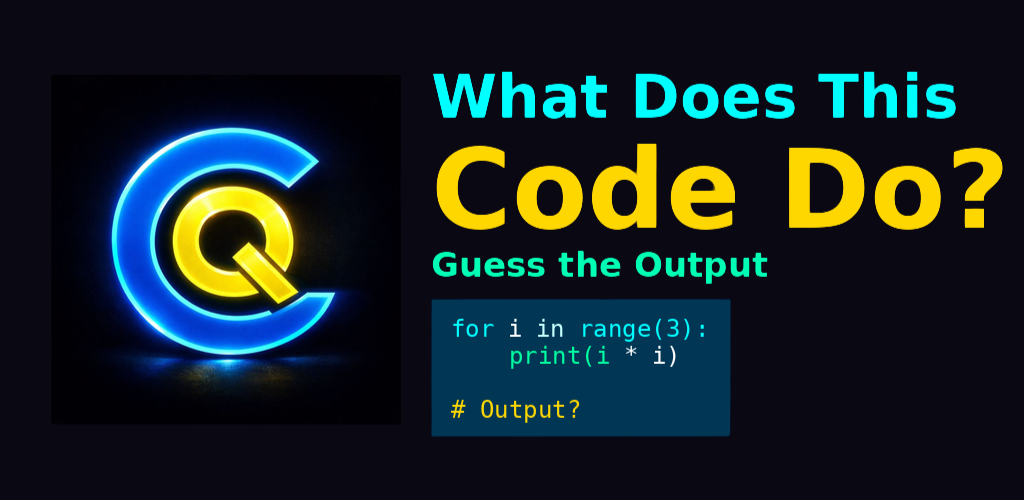

Teste dein eigenes Wissen

KI kann uns viel Zeit und Arbeit sparen, aber wir sollten trotzdem nicht unser eigenes Wissen vernachlässigen. Halte sich fit im programmieren mit Cyberskamp Quiz!

Cyberskamp Quiz kennenlernen1. Aufgabenarten: Generieren, Erklären, Prüfen

Wofür lassen sich ChatGPT und GitHub Copilot im Entwickler-Alltag nutzen? Grundsätzlich fallen die KI-Unterstützungen in drei Kategorien: generieren, erklären und prüfen. Schauen wir uns diese Aufgabentypen genauer an.

Generieren

Hier nimmt dir die KI das Schreiben von Code oder Texten ab. Das umfasst alles von Boilerplate-Code und sich wiederholenden Funktionen bis hin zu Config-Files, Tests oder Dokumentation. Genau diese monotonen Aufgaben delegieren viele Entwickler am liebsten an KI. ChatGPT kann z.B. auf Zuruf ganze Code-Blöcke oder Skripte erstellen, sei es ein Datenbank-Modell, ein API-Endpunkt oder ein Dockerfile für deinen Service. GitHub Copilot agiert eher im Hintergrund: während du Code schreibst, schlägt es automatisch passende Code-Vervollständigungen vor (oft ganze Zeilen oder Funktionen). So bekommst du in Sekunden eine Grundgerüst-Lösung, die du dann anpassen kannst. Indem die KI solche Routinen übernimmt, bleibt dir mehr Zeit für die interessanten Teile der Arbeit, wie zum Beispiel das Architekturdesign oder knifflige Algorithmik.

Erklären

Die KI als Mentor und Dokumentator. ChatGPT kann Code verständlich erklären oder zusammenfassen. Wenn du zum Beispiel einen fremden Code-Snippet nicht durchschaust, kopiere ihn in ChatGPT und bitte um eine Erklärung in einfachen Worten. In Sekundenschnelle erhältst du eine Aufschlüsselung, was der Code tut und warum. Das hilft nicht nur Einsteigern ungemein, sondern spart auch erfahrenen Entwicklern Zeit beim Einarbeiten in unbekannten Code. Ebenso kann ChatGPT Änderungen zusammenfassen („Fasse die letzten Commits zusammen“ ) oder Dokumentationstexte generieren. Viele Programmierer nutzen KI bereits, um Dokumentationen oder Code-Kommentare von der KI schreiben zu lassen. Das Ergebnis: Man versteht den Code besser und muss weniger selbst Schreibarbeit leisten.

Prüfen

Zwei (digitale) Augen sehen mehr als zwei menschliche. ChatGPT kann deinen Code überprüfen, nach Fehlern scannen und Verbesserungsvorschläge machen. Du kannst z.B. den KI-Assistenten um einen Code-Review bitten: „Schau dir folgenden Code an und nenne mögliche Bugs oder Sicherheitslücken.“ Das Modell wird typische Probleme aufzeigen (z.B. unüberprüfte Eingaben, ineffiziente Schleifen) und oft konkrete Verbesserungen vorschlagen. Auch beim Debugging kann KI helfen: Beschreibe ChatGPT eine Fehlermeldung oder ein falsches Verhalten, und es wird oft hilfreiche Hinweise zur Ursache liefern. Zwar behalten Entwickler bei kniffligen Problemen verständlicherweise gern selbst die Kontrolle, doch als smarter Helfer zum Ideen sammeln ist die KI Gold wert. Schließlich kann ChatGPT sogar Tests generieren, um deinen Code zu prüfen, aber dazu später mehr. Wichtig ist: Die KI liefert Vorschläge, du entscheidest als Mensch, was umgesetzt wird. Diese Mensch-KI-Zusammenarbeit (Human-in-the-Loop) sorgt dafür, dass am Ende Qualität und Sinn erhalten bleiben.

2. Prompt-Muster: Rolle, Constraints, Tests, Stil

Der Schlüssel zu nützlichen ChatGPT-Antworten liegt in der richtigen Eingabe. Dieser Eingabetext, der Befehl an die KI, wird als Prompt bezeichnet. Wie formulierst du Prompts, damit ChatGPT genau das liefert, was du brauchst, zum Beispiel fehlerfreien Code statt nur vager Tipps? Hier helfen erprobte Prompt-Muster. Vier Elemente haben sich bewährt:

Rolle zuweisen: Versetze ChatGPT in eine bestimmte Rolle oder Persona, damit die Antworten den gewünschten Ton und Fachwissen haben. Du könntest z.B. starten mit „Du bist ein erfahrener Senior-Softwareentwickler…“. Dadurch antwortet das Modell quasi mit der Expertise und dem Sprachstil eines Profi-Entwicklers. Ähnlich kannst du Rollen wie „Sicherheitsexperte“, „Technischer Redakteur“ oder „Tester“ vorgeben, je nachdem, was du gerade brauchst.

Constraints (Vorgaben und Grenzen): Scheue dich nicht, der KI klare Anweisungen und Grenzen zu setzen. Was soll unbedingt enthalten sein, was auf keinen Fall? Beispielsweise könntest du festlegen: „Verwende nur eingebaute Python-Bibliotheken“ oder „Der Code darf keine externen API-Calls machen“. Auch Stilvorgaben gehören hier rein (dazu gleich mehr). Solche Constraints engen den Lösungsspielraum bewusst ein und verhindern, dass ChatGPT vom Thema abdriftet oder Unerwünschtes tut. In einem Beispiel wurde etwa vorgegeben, dass ein Marketingplan keine Erwähnung von Wettbewerbern enthalten darf und ChatGPT hielt sich daran. Ähnlich kannst du in technischen Prompts festlegen, bestimmte Begriffe nicht zu verwenden oder bestimmte Muster einzuhalten.

Tests oder Beispiele einbeziehen: Ein Trick für präzisere Ergebnisse ist, ChatGPT kleineTestaufgaben oder Beispiele mitzugeben. Willst du z.B., dass eine generierte Funktion bestimmte Anforderungen erfüllt, könntest du einen Mini-Test beschreiben: „Schreibe Funktion X. Bei Eingabe Y sollte das Ergebnis Z sein.“ . Die KI bemüht sich dann, Code zu produzieren, der diesen Test besteht. Genauso kannst du Beispiel-Inputs/-Outputs angeben („Beispiel: bei n=5 sollte die Ausgabe 120 sein“) oder auch ChatGPT bitten, selbst Testfälle zu erstellen. So prüfst du gleich die Korrektheit der Lösung mit. Tests im Prompt fungieren als zusätzliche Leitplanken und Qualitätskontrolle während der Code-Generierung.

Stil und Format: Schließlich solltest du definieren, wie die Antwort formatiert sein soll. Möchtest du reinen Code als Antwort? Dann schreibe z.B. „Gib nur den finalen Code aus, ohne Erklärungen.“ Oder brauchst du einen erklärenden Text dazu, vielleicht in einer bestimmten Sprache? Dann formuliere das klar. Du kannst auch den Coding-Stil festlegen, etwa „im PEP8-Stil“ oder „nutze funktionale Programmierung“. Ebenso für sprachliche Antworten: Tonfall (locker vs. professionell), Länge (kurze Zusammenfassung vs. ausführlicher Bericht) und Struktur (Stichpunkte, Tabelle, Schritt-für-Schritt) lassen sich im Prompt steuern. Je konkreter du bist, desto eher entspricht die Antwort deinen Vorstellungen.

Diese Muster - Rolle, Constraints, Tests, Stil - kannst du nach Bedarf kombinieren. Ein guter Prompt könnte also etwa lauten: „Agiere als erfahrener Python-Entwickler. Erläutere im freundlichen, einfachen Ton, was das folgende Code-Snippet macht. Constraint: Keine fachlichen Begriffe, erkläre es so, dass ein Neuling es versteht. Format: Antworte in maximal 5 Sätzen.“. Mit solchen klaren Vorgaben steigt die Chance auf eine hilfreiche, zielgerichtete Antwort enorm. Merke: Ein präziser Prompt spart dir am Ende Zeit, weil du weniger nachbessern oder rückfragen musst.

3. Code-Generierung: Komponenten, Tests, Docs – in Minuten statt Stunden

Kommen wir zur Praxis: Wie genau sparen wir nun Zeit? Schauen wir uns typische Workflows an, bei denen ChatGPT und Copilot täglich Stunden wettmachen können. Drei wichtige Bereiche der Code-Generierung sind Komponenten-Code, Tests und Dokumentation.

Komponenten und Funktionen generieren

Stell dir vor, du sollst eine neue Komponente bauen, z.B. eine Datenverarbeitungs-Funktion, ein API-Endpunkt oder ein Stück Frontend-UI. Normalerweise fängst du bei Null an. Mit KI-Unterstützung bekommst du in Sekunden einen Entwurf. Du beschreibst ChatGPT knapp, was die Komponente tun soll (und ggf. Rahmenbedingungen) und erhältst einen Code-Vorschlag. Beispiel: „Schreibe eine Python-Funktion convert_to_csv(data), die eine Liste von Dictionaries als CSV auf stdout ausgibt.“ . ChatGPT liefert dir daraufhin einen funktionsfähigen Code inklusive Dateihandling. Natürlich musst du den Vorschlag prüfen und evtl. anpassen, aber die Grundarbeit ist erledigt. GitHub Copilot wiederum hilft dir, während du die ersten Zeilen tippst: Schreibst du def convert_to_csv(data): und drückst Enter, schlägt Copilot womöglich direkt den restlichen Funktionscode vor. Diese Autovervollständigungen basieren auf gelernten Mustern aus unzähligen ähnlichen Funktionen. Insbesondere Boilerplate-Code (immer gleiche Strukturen, z.B. Logging, Setter/Getter, Parser-Code) lässt du am besten komplett von der KI ausspucken. Das geht deutlich schneller, als von Hand Tipparbeit zu leisten und du vermeidest Flüchtigkeitsfehler. Studien zeigen, dass Entwickler mit Copilot viele Aufgaben spürbar schneller abschließen, besonders die repetitiven. Die Devise lautet: Die KI tippt, du denkst. So kannst du dich auf Architektur und knifflige Logik fokussieren, während ChatGPT & Copilot den monotonen Teil übernehmen.

Tests generieren

Tests zu schreiben kostet Zeit. Zeit, die viele von uns gerne sparen würden. Zum Glück sind KI-Tools perfekte Test-Automaten. Du kannst ChatGPT auffordern, für einen gegebenen Code Unit-Tests zu erstellen: „Schreibe Unit-Tests (mit pytest) für die folgende Funktion.“. Promptest du clever (z.B. „Berücksichtige dabei normale Fälle, Edge-Cases und Fehlerfälle“), bekommst du in Sekunden ein ganzes Bündel an Testfällen geliefert. Laut einem Bericht von Real Python reduziert ChatGPT die Zeit für’s Schreiben guter Tests erheblich, es generiert komplette Testsuiten auf Basis deines Codes oder deiner Spezifikation und deckt sogar Randfälle ab. Durch diese Effizienz kannst du dich auf die eigentliche Anwendungslogik konzentrieren, während die KI den Test-Framework-Code vorbereitet. Zudem denkt ChatGPT oft an Prüfszenarien, die dir selbst erst später einfallen würden, was die Testabdeckung verbessert. Natürlich gilt: Vertrau nicht blind, die generierten Tests solltest du kurz durchsehen. Aber in den meisten Fällen liefern sie einen exzellenten Startpunkt, den du höchstens leicht nachjustieren musst. Einige Entwickler berichten sogar, dass sie dank Copilot und ChatGPT häufiger Tests schreiben, weil die Hürde so viel geringer ist. Mehr Tests in kürzerer Zeit, das ist ein klarer Produktivitätsgewinn und ein Qualitätsplus obendrein.

Dokumentation und Kommentare

Kaum jemand schreibt leidenschaftlich gern Dokumentationen, außer vielleicht KI-Bots. ChatGPT liebt es hingegen, Texte zu formulieren. Warum also nicht Routine-Dokumentation an die KI auslagern? Ob Docstrings für Funktionen, Klassen-Dokumentation oder sogar ganze README-Abschnitte: Mit der richtigen Anleitung spuckt ChatGPT in Sekunden sauber formatierten Doku-Text aus. Zum Beispiel kannst du eingeben: „Schreibe einen Docstring für die obige Funktion mit Beschreibung, Parametern und Rückgabewert“ und der Assistent generiert dann etwas in dieser Art:

def add(a, b):

"""

Add two numbers together.

Args:

a (int): The first number.

b (int): The second number.

Returns:

int: The sum of the two numbers.

"""

return a + bWie man sieht, hast du ohne Mühe einen ordentlichen Kommentar erhalten. Genauso kannst du ChatGPT bitten: „Erstelle eine kurze Anleitung für die Installation und Nutzung meines Projekts XY.“ und bekommst einen fertigen Entwurf für die README. Viele Entwickler delegieren mittlerweile das Schreiben von Dokumentationstexten an KI, um sich selbst die Schreibarbeit zu erleichtern. Die KI ist dabei erstaunlich konsistent und schnell. Wichtig ist nur, dass du ihr genug Kontext gibst (z.B. erklärst, was dein Projekt grob macht), damit die Doku korrekt wird. Insgesamt kannst du so lästige Schreibarbeit massiv reduzieren. Statt eine Stunde Doku zu tippen, generierst du sie in 5 Minuten mit ChatGPT und polierst sie nur noch etwas. Das macht auf Dauer einen riesigen Unterschied.

4. Review und Sicherheitsnetze: Quality Assurance mit KI

Bei aller Begeisterung für die KI-Automatisierung: Verlass dich niemals blind auf die Ausgabe. Code-Reviews und Tests bleiben essenziell, gerade wenn ein Großteil des Codes von einer KI stammt. Sieh ChatGPT und Copilot als superschnelle Helfer, aber du bist weiterhin der Qualitätsmanager. Hier ein paar Strategien, wie du KI-generierten Code absicherst:

Manuelles Code-Review

Nimm den von ChatGPT vorgeschlagenen Code stets kritisch unter die Lupe. Läuft er überhaupt durch? Entspricht er dem, was gefordert war? Achtung: KI-Code wirkt oft auf den ersten Blick plausibel, kann aber versteckte Fehler haben. Microsoft-Forscher stellten fest, dass Copilot manchmal Code liefert, der „richtig aussieht, aber es nicht ist“. Also: Kompiliere/Starte den Code und teste die Funktionalität. Überprüfe insbesondere Randfälle und Fehlerbehandlung. Macht der Code wirklich, was er soll, auch in ungewöhnlichen Situationen? Oft lohnt es sich, ChatGPT direkt nach einem Review zu fragen (sozusagen KI prüft KI): „Analysiere den obigen Code und nenne mögliche Probleme“. Interessanterweise findet das Modell manchmal eigene Fehler oder Ungenauigkeiten im erzeugten Code und verbessert sie. Dennoch ersetzt das kein menschliches Augenmaß.

Statische Codeanalyse

Nutze zusätzlich automatisierte Tools wie Linter und Static-Analysis-Werkzeuge. Sie greifen dir als „Sicherheitsnetz“ unter die Arme, indem sie offensichtliche Probleme hervorheben, wie z.B. Syntaxfehler, nicht genutzte Variablen, Typkonflikte oder Sicherheitslücken. Wenn Copilot z.B. einen Code-Vorschlag macht, der veraltete oder unsichere Praktiken enthält, wird dein Linter (oder SonarQube, ESLint, Pylint etc.) Alarm schlagen. Solche Tools lassen sich schnell über den KI-Code drüber laufen und filtern grobe Patzer raus. Das ist besonders hilfreich, weil KI-Modelle keinen echten Projektkontext haben und z.B. manchmal benötigte Import-Anweisungen „vergessen“. In einem Beispiel generierte ChatGPT zwar scheinbar funktionierenden Code für JSON-Verarbeitung, ließ aber den wichtigen import json Befehl aus. Ein einfaches statisches Analyse-Tool oder dein eigener geübter Blick hätten das sofort bemerkt. Fazit: Vertrau, aber prüfe. Lass die KI ruhig mal 100 Zeilen Code schreiben, aber schalte danach deinen Compiler, Linter und dein Gehirn ein 😉

Automatisierte Tests ausführen

Wir haben gesehen, ChatGPT kann Tests erzeugen, setze diese auch ein! Führ die generierten Unit-Tests tatsächlich aus in deiner Umgebung. Schlägt einer fehl, ist das ein klarer Hinweis, dass im Code noch ein Fehler steckt. Überhaupt solltest du KI-Code so früh wie möglich laufen lassen und mit echten Daten testen. Dadurch validierst du, ob alles wie erwartet funktioniert. Ein potenzieller Nachteil von KI-generiertem Code ist, dass man geneigt ist zu glauben „Wird schon stimmen, die KI weiß das doch“. Dem ist aber nicht so. Large Language Models haben kein garantiert korrektes Weltwissen, sie raten in gewissem Sinne. Daher: jedes Feature einmal testen (manuell oder automatisch), bevor es in Produktion geht. Interessant am Rande: In einer Studie merkten Entwickler an, dass das Überprüfen der KI-Antworten manchmal so viel Zeit kostet, dass der Produktivitätsgewinn teilweise aufgehoben wird. Dem kannst du entgegenwirken, indem du die richtigen Sicherheitsnetze etablierst, also automatisierte Checks, gute Testabdeckung und klare Coding-Standards, an denen du die KI-Ergebnisse misst. So hältst du die Balance zwischen Speed und Qualität.

Zusammengefasst: KI-Code sollte immer mit einer Portion Misstrauen behandelt werden. Mit Code-Review, Lintern und Tests stellst du sicher, dass „schneller Code“ nicht „schlechter Code“ bedeutet. Dann profitierst du maximal von der Zeitersparnis, ohne Schiffbruch durch Bugs zu erleiden.

5. Grenzen & „Human-in-the-Loop“

Auch wenn ChatGPT und Copilot beeindruckend viel leisten, sie sind keine magischen Einhörner. Es gibt klare Grenzen, die du kennen solltest und Gründe, warum der Mensch weiterhin unerlässlich bleibt.

Limitiertes Kontext- und Logikverständnis

KI-Modelle haben kein ganzheitliches Verständnis deines Projekts. Sie generieren Output auf Basis von Wahrscheinlichkeiten und Mustern aus den Trainingsdaten, ohne echten Durchblick. Komplexe Architektur-Entscheidungen oder tief verschachtelte Logik können sie nicht wirklich durchdringen. Das führt dazu, dass bei anspruchsvollen Aufgaben die Vorschläge schnell an Qualität verlieren oder gar falsch sind. Viele Entwickler berichten, dass sie KI bei schwieriger Anwendungslogik oder bei hartem Debugging lieber außen vor lassen, hier behalten sie lieber selbst die Kontrolle. Tatsächlich nennt die JetBrains-Umfrage ein begrenztes Verständnis komplexer Logik als Hauptbedenken beim KI-Code. Die Tools liefern zwar oft einen Ausgangspunkt, aber um wirklich robuste Lösungen zu bauen, muss der Mensch das Heft in der Hand behalten.

Inkonsequente Code-Qualität

Mal glänzt der KI-Code, mal produziert er Unsinn, die Qualität ist nicht konsistent. Eine der größten Sorgen unter Entwicklern ist genau diese Schwankung in der KI-Codequalität. Du kannst nie 100% sicher sein, ob der nächste Vorschlag brilliant oder Bullshit ist, ohne ihn zu prüfen (siehe vorheriges Kapitel). Gerade subtil falscher Code ist gefährlich, weil er auf den ersten Blick okay aussieht. Hier trennt sich die Spreu vom Weizen: Ein erfahrener Entwickler merkt es und korrigiert, ein unerfahrener könnte den Fehler übersehen. Daher gilt: Immer schön den gesunden Menschenverstand einschalten. Die KI ist ein Assistent, kein allwissender Programmierer.

Datenschutz und Sicherheitsrisiken

Ein oft übersehener Punkt: Sobald du Code oder Daten in ChatGPT eingibst, verlässt diese Information potenziell dein Unternehmen. Vertrauliche Daten oder proprietärer Code sollten nicht ungefiltert an externe KI-Services geschickt werden. Viele Firmen sind daher (zu Recht) vorsichtig mit dem Einsatz von Cloud-KI beim Entwickeln. Außerdem könnten KI-Vorschläge lizenzrechtliche Implikationen haben, wenn etwa Code aus öffentlichen Repos wiederverwendet wird. Das Thema ist komplex, aber die Kurzfassung: Teile sensible Dinge nur, wenn du sicher bist, was mit den KI-Daten passiert und prüfe die Vorschläge auf etwaige Copyright-Probleme. Datenschutz und Security zählen ebenfalls zu den Top-Bedenken beim KI-Einsatz. Copilot hat zwar Filter, um z.B. lange bekannte Codepassagen nicht 1:1 auszugeben, aber eine Restunsicherheit bleibt.

Auswirkungen auf deine Skills

Zuletzt und gerade für unerfahrene Entwickler wichtig: Verlerne nicht das Programmieren, nur weil die KI dir so viel abnimmt! Einige befürchten, dass zu viel Abhängigkeit von Copilot & Co die eigenen Coding-Fähigkeiten auf Dauer einrosten lässt. Und tatsächlich: Wenn man monatelang nur noch KI-Vervollständigungen akzeptiert und kaum selbst nachdenkt, fehlt einem irgendwann die Übung im Problemlösen. Mach dir das bewusst und nutze die KI begleitend, nicht als Ersatz für eigene Anstrengung. Ein schöner Ansatz ist „KI als Lehrmeister“: Lass dir von ChatGPT ruhig Lösungen vorschlagen, aber bitte auch um Erklärungen, damit du den Code verstehst. So lernst du sogar noch dabei. Halte dich außerdem nicht zurück, eigene Ideen auszuprobieren, denn die KI ist geduldig und hilft dir beim Verbessern. Human-in-the-Loop bedeutet, dass der Mensch weiterhin die Instanz ist, die den Prozess steuert, validiert und kreativ leitet. Die KI liefert zu, aber du gibst den Takt vor.

Fazit der Grenzen

ChatGPT und GitHub Copilot sind fantastische Beschleuniger für Routineaufgaben, aber sie ersetzen weder deinen Kopf noch dein Bauchgefühl. Behalte komplexe Entscheidungen in Menschenhand, überprüfe KI-Ergebnisse kritisch und sorge dafür, dass du die Kontrolle über den Code behältst. In dieser Mensch-KI-Partnerschaft steckt enormes Potenzial, solange du die Schwächen kennst und abfederst.

6. Starter-Prompt-Library: Deine KI-Workflows zum Ausprobieren

Zum Abschluss haben wir dir eine kleine Prompt-Bibliothek zusammengestellt. Diese Beispiele helfen dir, sofort loszulegen und typische Entwickler-Workflows mit KI umzusetzen. Fühle dich frei, die Formulierungen anzupassen, denn sie dienen nur als Ausgangspunkt:

Code generieren: „Du bist ein erfahrener Senior-Entwickler. Schreibe in Python eine Funktion calculate_statistics(data), die eine Liste von Zahlen entgegennimmt und Minimum, Maximum und Durchschnitt als Dictionary zurückgibt. Achte auf effiziente Umsetzung und klare Struktur. Kommentiere den Code gut.“

Was bewirkt dieser Prompt? Er weist ChatGPT an, Code in einer bestimmten Sprache zu erzeugen, gibt der KI eine Rolle (Senior-Entwickler) und definiert klar die Aufgabe samt Ausgabetyp. Zudem fordert er Effizienz, Struktur und Kommentare, so bekommst du sofort brauchbaren, gut kommentierten Code für diese Anforderung.Code erklären: „Du bist ein Software-Experte und Tutor. Erkläre Schritt für Schritt in einfachen Worten, was der folgende Code tut und warum er so implementiert wurde. Vermeide Fachjargon: [Hier den Code einfügen]“

Erläuterung: Dieser Prompt lässt ChatGPT die Rolle eines geduldigen Lehrers einnehmen. Ideal, um komplexen Code verständlich erklärt zu bekommen. Die Anweisung, Fachjargon zu meiden, stellt sicher, dass auch weniger Erfahrene der Erklärung folgen können.Code überprüfen (Review): „Übernimm die Rolle eines Code-Reviewers mit Fokus auf Best Practices. Prüfe den folgenden Python-Code auf Fehler, potentielle Sicherheitslücken und Optimierungsmöglichkeiten. Gib ein ausführliches Feedback mit konkreten Verbesserungsvorschlägen: [Code einfügen]“

Erläuterung: Hier wird die KI zum strengen Reviewer. Sie wird den Code durchforsten und z.B. ineffiziente Stellen, mögliche Bugs oder Verletzungen von Stilrichtlinien anmerken. Du erhältst quasi ein zweites Paar Augen, das dich auf Dinge hinweist, die dir entgangen sind, inklusive Tipps, wie es besser geht.Fehlersuche (Debugging): „Du bist ein sehr erfahrener Entwickler für Fehlersuche. Ich habe folgendes Problem: [Fehlerbeschreibung oder Fehlermeldung]. Analysiere den zugehörigen Code (siehe unten) und erkläre die wahrscheinliche Ursache des Fehlers. Zeige mir anschließend, wie man den Fehler behebt. Code: [Code einfügen]“

Erläuterung: Dieser Prompt ist gold wert, wenn man vor einem kryptischen Fehler steht. Die KI wird versuchen, aus Beschreibung und Code die Ursache zu erschließen (z.B. falsche Variableninitialisierung oder Off-by-One-Fehler) und gibt einen Vorschlag zur Lösung. Das ersetzt zwar kein gründliches eigenes Debugging, kann aber oft einen entscheidenden Hinweis liefern.Tests schreiben: „Agiere als Test-Automatisierungs-Experte. Schreibe Unit-Tests mit pytest für die folgende Funktion. Berücksichtige dabei typische Anwendungsfälle, Randfälle (edge cases) und Fehlerfälle. Funktion: [Code einfügen]“

Erläuterung: Damit generiert ChatGPT eine Reihe von Testfunktionen, die sicherstellen, dass die gegebene Funktion in verschiedensten Szenarien korrekt arbeitet. Die Anweisung deckt sowohl Standard- als auch Sonderfälle ab. So bekommst du schnell eine solide Testbasis, ohne selbst alle Testideen durchdenken zu müssen.Dokumentation generieren: „Du bist technischer Redakteur. Schreibe eine kurze README-Einführung für mein Projekt XY. Erläutere prägnant Zweck und Hauptfunktion des Projekts, zeige die Schritte zur Installation und ein kleines Anwendungsbeispiel auf. Verwende eine freundliche, klare Sprache.“

Erläuterung: Dieser Prompt liefert dir einen ersten Entwurf einer Projekteinführung, wie sie auf GitHub README-Dateien üblich ist. ChatGPT formuliert den Nutzen deines Projekts, erklärt die Installation und sogar ein Beispiel, all das in Sekunden. Du kannst den Text dann noch mit projektspezifischen Details anreichern. Das Ergebnis: Eine lästige Aufgabe weniger, Zeit gespart!

Mit dieser Prompt-Bibliothek in der Hinterhand kannst du direkt experimentieren. Kopiere einen passenden Prompt, passe ihn für deinen Anwendungsfall an und lass ChatGPT für dich arbeiten. Schon nach kurzer Zeit wirst du ein Gefühl dafür entwickeln, welche Anweisungen gute Ergebnisse liefern.

Pro-Tipp: Speichere dir erfolgreiche Prompts ab (z.B. in einer persönlichen Sammlung), um sie immer wiederzuverwenden. Viele Entwickler bauen sich so eine eigene Prompt-Bibliothek auf, genau wie wiederverwendbare Code-Snippets.

Fazit

ChatGPT und GitHub Copilot können deine Produktivität als Entwickler enorm steigern, wenn du sie gezielt einsetzt. Delegiere langweilige Routinejobs an die KI und nutze die gewonnene Zeit für die spannenden Aspekte der Entwicklung. Gleichzeitig bleib wachsam, prüfe Ergebnisse und lerne von der KI. So hast du das Beste aus beiden Welten: Geschwindigkeit und Qualität. Viel Erfolg beim Ausprobieren! 🚀

Neugierig geworden? 👉 Probiere meine Beispielprompts aus und abonniere meinen Newsletter, um immer über Neuigkeiten informiert zu werden. Viel Spaß beim Zeitsparen! 😊

Kommentare

Bitte melde dich an, um einen Kommentar zu schreiben.